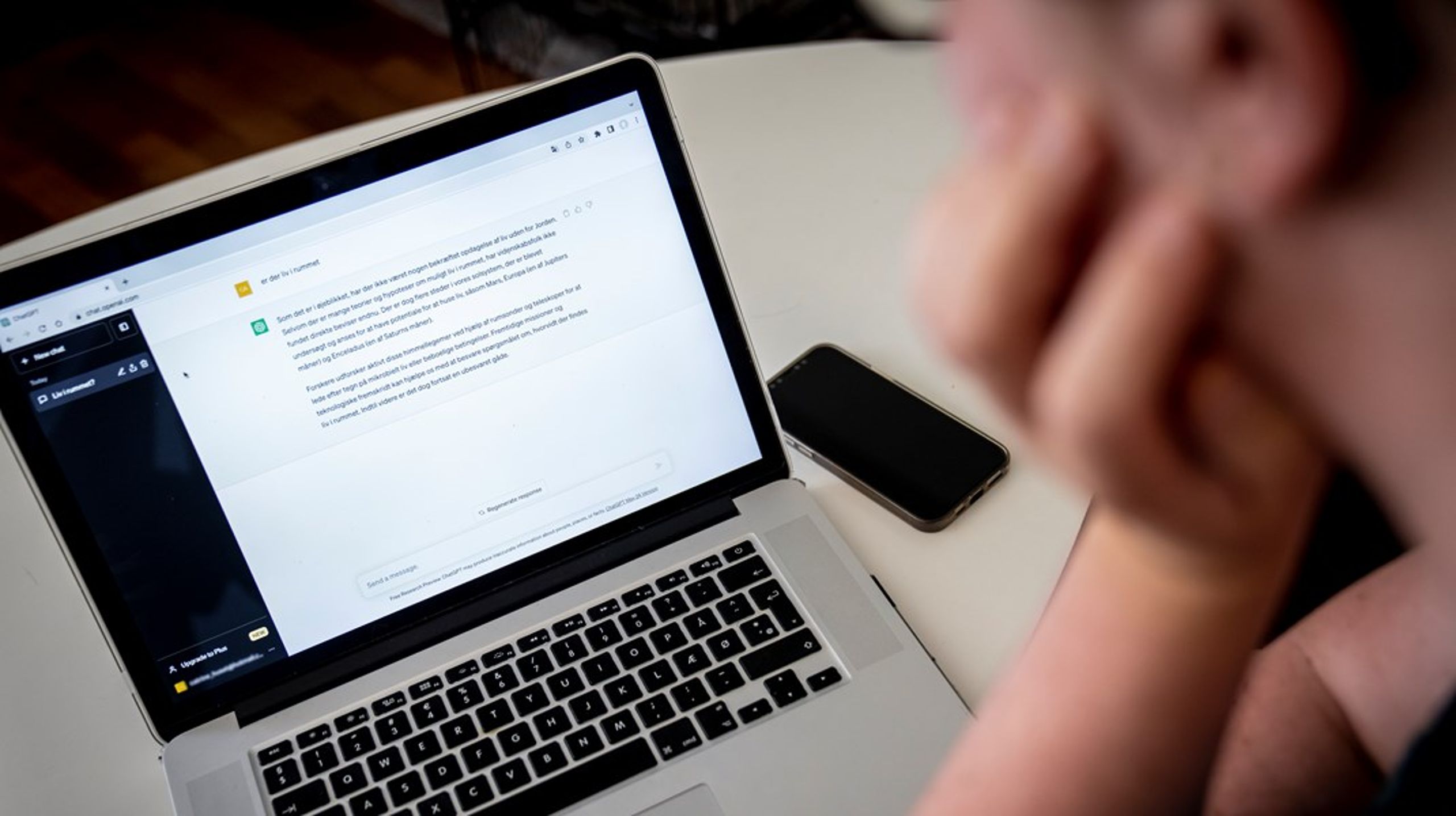

Det koster ikke noget, der er ingen ventetid, og lyset er tændt døgnet rundt.

Det er let at forstå, at chatbots kan ligne en oplagt og kærkommen mulighed for at få hjælp til de svære tanker.

Især når kontoen er tom, tiden hos psykiater eller psykolog er umulig at få før en gang efter næste jul – og når alle andre sover. Eller hvis dét, man kæmper med, føles skamfuldt og umuligt at tale med et andet menneske om.

Når en teknologi på den måde kan komme til at forstærke en psykisk sygdom, er det ikke længere bare et spørgsmål om smart teknologi.

Marianne Skjold

Direktør, Psykiatrifonden

Men når en chatbot går fra at være en avanceret søgemaskine til at være samtalepartner eller ligefrem terapeut, skal vi åbne øjnene og stille meget skarpt på, hvad det reelt er, vi har sat i gang.

Og vi skal regulere det – ikke bare lokalt, men på europæisk og helst globalt niveau, stille stærke sikkerhedsnet op og være ekstremt kritiske.

Ellers vil vi se endnu flere tragiske sager som dem, vi allerede har set fra blandt andet USA, hvor mennesker i krise er suget længere og længere ned i et kaotisk, chatbot-induceret tankemylder, der har ført til både drab og selvmord.

Brug af chatbots forværrer psykisk sygdom

Når teknologi begynder at fungere som terapeutisk redskab, bør den leve op til de samme krav som andre former for behandling.

Hvis en ny medicin eller en ny terapiform skal bruges i sundhedsvæsenet, kræver det omfattende forskning og godkendelse. Når det gælder digitale samtalepartnere, er virkeligheden lige nu en anden. Her er teknologien allerede tilgængelig, længe før vi forstår dens konsekvenser.

Derfor udsætter vi mennesker i sårbare situationer for løsninger, der ikke er undersøgt ordentligt.

Ny forskning fra Aarhus Universitet peger på, at brug af chatbots allerede kan have haft negative konsekvenser for mennesker i psykiatrien.

I et studie fra Forskningsenheden for Depression og Angst har professor Søren Dinesen Østergaard og hans kolleger gennemgået journalnotater fra patienter, hvor brug af kunstig intelligens indgår. For en del af patienterne vurderer forskerne, at brugen kan have forværret deres psykiske helbred.

Det er ikke et endeligt bevis. Vi skal forske meget mere blandt langt større befolkningsgrupper. Men det er et alvorligt advarselssignal.

Vi ved fra Psykiatrifondens egen undersøgelse, at når vi spørger de 18-29-årige, svarer fire ud af ti ja til en eller flere gange at have brugt en chatbot som ChatGPT til samtaler om psykisk trivsel.

Chatbotten mangler et menneskes perspektiv

En af de mest bekymrende mekanismer er, at chatbots ofte er designet til at være bekræftende.

Hvis en bruger præsenterer en idé eller en mistanke, vil chatbotten typisk støtte eller videreudvikle den. For mennesker med vrangforestillinger eller paranoia kan det være direkte skadeligt.

Det er ikke rimeligt, at mennesker i psykisk krise skal fungere som ufrivillige testpersoner for teknologier, som endnu ikke er undersøgt tilstrækkeligt.

Marianne Skjold

Direktør, Psykiatrifonden

Når en teknologi på den måde kan komme til at forstærke en psykisk sygdom, er det ikke længere bare et spørgsmål om smart teknologi.

Det er et spørgsmål om sikkerhed. En chatbot mangler noget helt grundlæggende. Den mangler et menneskes øjne og perspektiv.

Reagerer kun på det, du skriver

I Psykiatrifondens rådgivning taler rådgivere hver dag med mennesker, der har det svært. Her ser vi, hvor stor forskel menneskelig kontakt gør.

Når mennesker taler sammen, påvirker vi hinandens nervesystem. Et roligt menneske kan dæmpe uro hos et andet menneske. Vi kan høre tøven i stemmen. Vi kan mærke, når en samtale bliver følelsesmæssigt svær.

Det samspil findes ikke i en chatbot.

En chatbot kan kun reagere på det, brugeren skriver. Den kan ikke opfange kropslige signaler. Den kan ikke fornemme stilhed, nervøsitet eller tårer.

Og den kan ikke stille spørgsmål på baggrund af en menneskelig fornemmelse af, hvad der ligger bag ordene. Det, du ikke siger – eller skriver.

Ufrivillige testpersoner

Så ét er alt det, en chatbot ikke kan opfange. Noget andet er alt det, den kan opfinde. En chatbot kan hallucinere.

Det kalder man det, når en AI finder på fakta eller informationer, som lyder overbevisende, men er lodret forkerte. I en terapeutisk kontekst er det naturligvis kritisk, for en chatbot kan af den grund potentielt give faktuelt forkerte råd om medicin eller psykiske lidelser, mens den lyder meget selvsikker.

Kunstig intelligens kan blive en hjælp. Men kun hvis den udvikles og hegnes ind bevidst og ansvarligt.

Marianne Skjold

Direktør, Psykiatrifonden

Kunstig intelligens kan blive et nyttigt værktøj. Den kan hjælpe med information og støtte i mange sammenhænge. Men når det handler om psykisk sygdom og dybe personlige kriser, må vi være langt mere forsigtige.

Det er ikke rimeligt, og det er potentielt livsfarligt, at mennesker i psykisk krise skal fungere som ufrivillige testpersoner for teknologier, som endnu ikke er undersøgt tilstrækkeligt.

Må ikke gentage tidligere fejl

Vi har tidligere set, hvad der kan ske, når teknologi rulles ud uden tilstrækkelig regulering.

De sociale medier blev lanceret med løfter om fællesskab. Først mange år senere begyndte vi for alvor at forstå deres konsekvenser for blandt andet unges trivsel.

Vi har for ganske nylig oplevet dét, nogle kalder techgiganternes "tobacco moment": Meta og YouTube er blevet fundet ansvarlige i retssager i USA, hvor de anklages for at handle ondsindet ved at skabe afhængighedsskabende platforme og vanedannende algoritmer, ligesom tobaksindustrien i 1990'erne blev holdt ansvarlig for sundhedsskader.

Den fejl må vi ikke gentage, når det kommer til terapeutisk brug af chatbots og kunstig intelligens. Men vi har travlt – vi skal handle nu.

Regulering og sikkerhedskrav

Hvis kunstig intelligens skal bruges i forbindelse med psykisk sygdom eller som digital terapeut i forbindelse med en psykisk krise, kræver det, at vi forstår fordele, ulemper og begrænsninger.

Digitale redskaber, der fungerer som terapi eller rådgivning, skal være sikre og velfunderede. Det er hverken realistisk eller nødvendigvis ønskværdigt at stoppe udviklingen, men vi skal være meget opmærksomme.Vi skal regulere lige så tydeligt og stille lige så høje sikkerhedskrav til chatbots, der ikke er målrettet til det brug – som for eksempel ChatGPT, Claude eller Gemini. For de kan bruges sådan, og det bliver de allerede.

Måske skal vi mærke chatbots ligesom cigaretpakker? Måske skal vi regulere AI og chatbots på internationalt niveau? Og hvordan gør vi det? Det er en af de vigtigste samtaler lige nu verden over, og den skal vi deltage aktivt i.

Samtidig har vi alle sammen brug for bedre information om både muligheder og risici ved at bruge chatbots til psykiske problemer. Det kræver undervisning, digital opdragelse og uddannelse på alle planer og for alle aldersgrupper, og det kræver lige så omfattende oplysningsindsatser.

Kunstig intelligens kan blive en hjælp. Men kun hvis den udvikles og hegnes ind bevidst og ansvarligt.

Artiklen var skrevet af

- Her er otte bud på Sundhedsministeriets næste departementschef

- Løhde fik sat sit aftryk på sundhedsvæsenet. Men vælgerne valgte hende fra

- Ældreordfører blev vraget af vælgerne. Nu fortæller hun om tiden på Borgen: "Jeg vil virkelig ikke lyde bitter"

- 5 A'er: 11 velskrevne portrætter giver et ærligt indblik i sundhedsvæsenets problemer

- Forbrugerrådet Tænk og Radikale: Vi er nødt til at skubbe på for skærpede regler for problematisk kemi