Forskere: AI kan få forskningen ud af elfenbenstårnet – men også misinformere masserne

Simon Fuglsang, Antoinette Fage-Butler og Kristian Hvidtfelt Nielsen

hhv. ph.d.-studerende og lektorer fra Aarhus Universitet

I en ny rapport fra projektet Viden og Demokrati svarer ti procent af deltagerne mellem 18 og 34 år, at "ChatGPT og andre AI" er blandt deres primære kilder til at tilgå forskningsbaseret viden.

Det er et interessant tal, der peger på, at AI-assisterede teknologier kommer til at spille en rolle for forskningskommunikation fremadrettet. Reaktionerne strækker sig fra frygt for spredning af misinformation til en høj grad af optimisme omkring disse teknologiers evne til at nedbryde barrierer mellem befolkningen og forskningsverdenen.

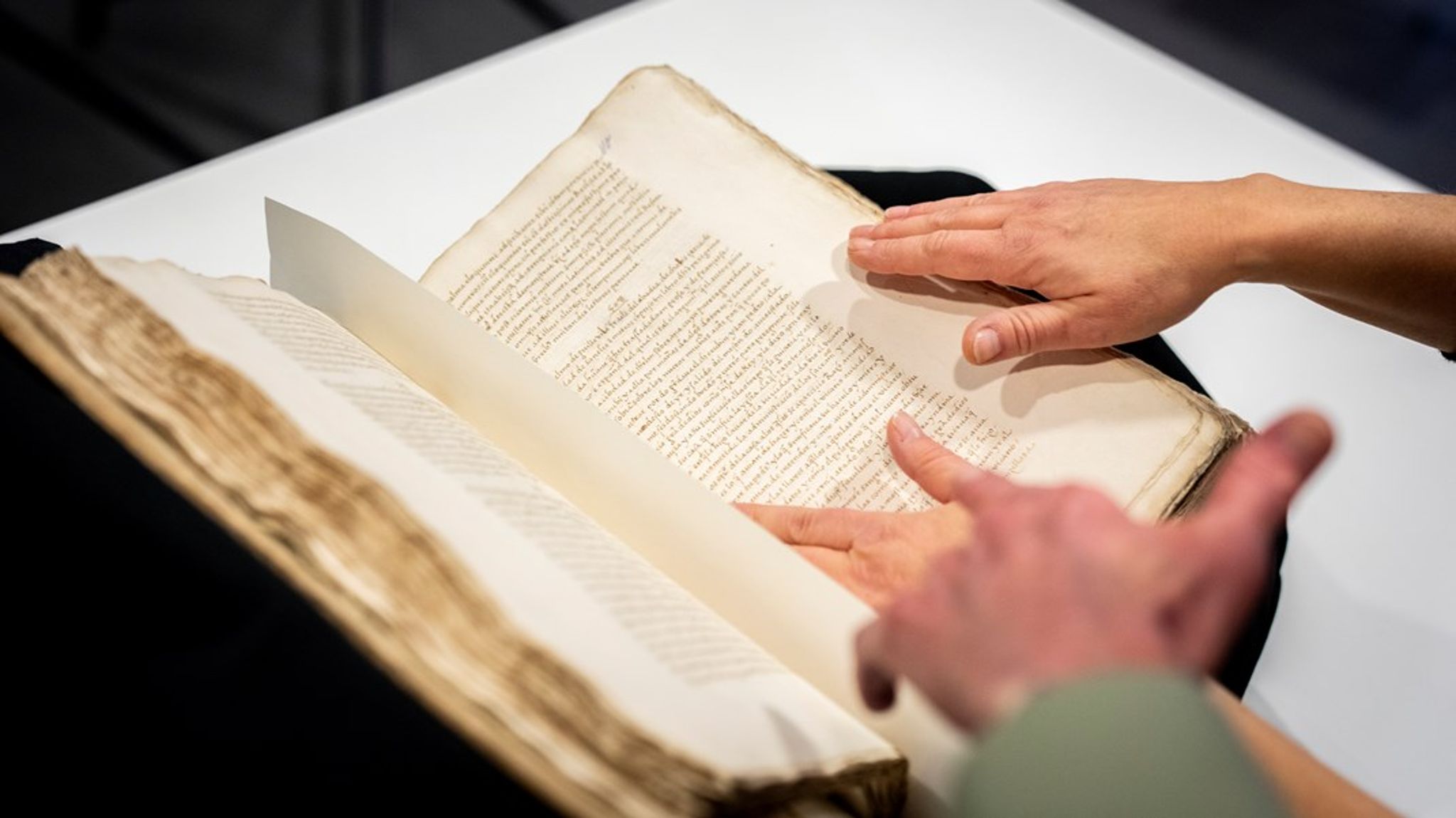

Frygten for misinformation er ikke ny. Samme frygt opstod i 1500-tallet, da de første trykkerier begyndte at sprede sig i Europa, og tættere på vores tid i 2000'erne med udbredelsen af world wide web og sociale medier.

Det bliver kompliceret at uddanne til kildekritik, når afsenderen er en AI-assisteret algoritme.

Simon Fuglsang, Antoinette Fage-Butler og Kristian Nielsen

Aarhus Universitet

Komplicerer kildekritikken

Den reelle fare for, at forkert eller ligefrem farlig information spreder sig under dække af at have videnskabelig autoritet, er svær at vurdere.

Problemet med forskningslignende misinformation har tidligere vist sig at være overdrevet, for mængden og kvaliteten af troværdig information synes at være steget tilsvarende eller mere.

Det er et åbent spørgsmål, hvorvidt store sprogmodeller som ChatGPT kan medvirke til at producere og sprede store mængder af misinformation, eller ikke, og hvordan sådan information modvirkes.

Hvad stiller vores universiteter og forskning op med kunstig intelligens?

Kunstigt intelligente chatbots er efterhånden blevet en del af hverdagen de danske campusser.

Med en enkelt kommando kan forskere og studerende hurtigt få svar på alverdens spørgsmål. Derfor spørger Altinget Forskning nu: Hvordan bør universiteter og forskere forholde sig til kunstig intelligens?

Se oplægget til debatten og panelet lige her.

Om Altingets temadebatter

Alle indlæg er alene udtryk for skribenternes egen holdning.

Altinget bringer kun debatindlæg, som udelukkende er skrevet til Altinget.

Har du lyst til at bidrage til debatten, er du velkommen til at skrive til bach@altinget.dk for at høre om mulighederne.

Det bliver kompliceret at uddanne til kildekritik, når afsenderen er en AI-assisteret algoritme, der kan opbygge ny information på baggrund af næsten al information og kommunikation fra internettet.

Algoritmer er de nye biblioteker

Adgang til information og brug af information har altid været styret af algoritmer, forstået som metoder til at opsøge, kombinere og producere ny information.

Tidligere var det bibliotekskartoteker, tidsskriftskataloger, arkivregistranter og lignende, og de blev kun brugt af relativt få forskere.

Nu er det digitale søgemaskiner, som bliver brugt af næsten alle, eller sprogmodeller som ChatGPT, som sikkert kommer til at dominere informationssøgning i fremtiden.

Udfordringen er den samme: Vi skal blive bedre til at forstå og bruge de algoritmer, der strukturerer og genererer information for os.

AI kan demokratisere forskningen

Forskning har aldrig været demokratisk, men derimod domineret af en lille elite. De har haft – og har – autoritet til at afgøre, hvad der er god og sand viden. Forskningskommunikation er et forsøg på at gøre denne viden mere tilgængelig, med større eller mindre held.

Algoritmer kan være tilsvarende ulighedsskabende. AI-assisterede teknologier har allerede vist sig at reproducere og ofte forøge den ulighed, som allerede eksisterer i samfundet.

Inden for forskningsverden risikerer AI at medvirke til at øge uligheden, som Johannes Bjerva fra Aalborg Universitet har peget på. Også forskningskommunikationen kan ende med at blive mindre mangfoldig og mere udemokratisk.

Opgaven er den samme som før. Vi skal arbejde hårdt og målrettet for at sikre kvaliteten og bredden af forskningskommunikation.

Simon Fuglsang, Antoinette Fage-Butler og Kristian Nielsen

Aarhus Universitet

Heldigvis er der mulighed for at præge udviklingen. Mike Schäfer fra University of Zürich fremhævede for nyligt potentialet for en yderligere demokratisering af forskningskommunikation gennem dialogisk interaktion med ChatGPT og andre AI.

Herved opstår en simuleret samtale-med-viden, som kan være med til at målrette og tilpasse forskningskommunikationen til en langt større del af befolkningen, nok særligt de yngre.

Derfor er der brug for mere viden om, hvordan forskningskommunikation kan integrere AI-assisterede teknologier, og hvilke færdigheder der kræves af brugeren. I særdeleshed hvis vi ønsker at øge ligheden i adgangen til information gennem teknologier som disse.

Opgaven er den samme

Vi ved endnu ikke, hvilken rolle disse teknologier kommer til at spille. En dag vil de være værktøjer i hverdagen som andre informations- og kommunikationsteknologier. Vi ender nok hverken i utopi eller dystopi.

Opgaven er den samme som før. Vi skal arbejde hårdt og målrettet for at sikre kvaliteten og bredden af forskningskommunikation. Det kræver bred og aktiv deltagelse fra forskningsverden, medier og formidlere, undervisningssektoren og mange flere.

Indtil videre har udviklingen af AI-assisterede teknologier primært været drevet af forsknings- og industriinteresser. Det har skabt masser af teknologiske muligheder og tilhørende risici. Nu er det op til andre aktører at sikre en demokratisk og retfærdighed forankring.

Indsigt

Julio E. Celis85 år

Julio E. Celis85 årI dag

Professor, rådgiver, det videnskabspolitiske udvalg under European Academy of Cancer Sciences Torben Kylling Petersen51 år

Torben Kylling Petersen51 årI dag

Fhv. adm. direktør, Destination Vesterhavet Anne Merrild51 år

Anne Merrild51 årI dag

Professor og institutleder, Institut for Bæredygtighed og Planlægning, Aalborg Universitet

Søren Egge Rasmussen spørger Jacob JensenEr ministeren enig i, at mindstekrav til hold af grise ikke lever op til dyrevelfærdsloven?Besvaret

Søren Egge Rasmussen spørger Jacob JensenEr ministeren enig i, at mindstekrav til hold af grise ikke lever op til dyrevelfærdsloven?Besvaret Lotte Rod spørgerHvad er ministerens holdning til, at forældre til børn med handicap rammes af tre former for skjult vold, når de søger hjælp?Besvaret

Lotte Rod spørgerHvad er ministerens holdning til, at forældre til børn med handicap rammes af tre former for skjult vold, når de søger hjælp?Besvaret

Aaja Chemnitz spørger Ane Halsboe-JørgensenVil ministeren sikre, at grønlandske studerende understøttes under deres ophold i Danmark?Besvaret

Aaja Chemnitz spørger Ane Halsboe-JørgensenVil ministeren sikre, at grønlandske studerende understøttes under deres ophold i Danmark?Besvaret

- L 121 Universitetsloven med videre (Uddannelses- og Forskningsministeriet)1. behandling

- L 131 Lov om erhvervsuddannelser med videre (Børne- og Undervisningsministeriet)1. behandling

- L 132 Lov om videnskabsetisk behandling af sundhedsvidenskabelige og sundhedsdatavidenskabelige forskningsprojekter med videre (Indenrigs- og Sundhedsministeriet)1. behandling