Danmark er kendt som en digital frontløber, og vores offentlige sektor har ofte været fremhævet som en af verdens mest digitaliserede. Denne position giver os et unikt udgangspunkt for at udnytte nye teknologier som generativ kunstig intelligens (GenAI).

GenAI er en banebrydende teknologi, der har stort potentiale for at effektivisere og forbedre offentlige tjenester. Men når offentlige myndigheder bruger teknologien, medfølger der et stort ansvar: Hvordan kan vi sikre, at GenAI anvendes på en måde, der ikke kun er teknisk solid, men også dataetisk forsvarlig?

Dataetisk Råd udgav 5. februar sin seneste rapport, som stiller skarpt på, hvordan man kan tackle den centrale dataetiske udfordring, at generativ AI laver fejl. Sådanne fejl kan have vidtrækkende konsekvenser, når offentlige myndigheder anvender GenAI.

Men offentlige myndigheder er forpligtede til både at informere præcist og træffe korrekte beslutninger, så hvordan definerer vi acceptable risici, og hvilke mekanismer skal sikre, at fejl opdages og rettes, når vi taler GenAI?

Med otte klare anbefalinger peger Dataetisk Råd på, hvad offentlige myndigheder kan gøre for at minimere risikoen, og hvordan vi som samfund kan sikre etisk anvendelse af GenAI. Sådan kan vi understøtte tilliden til vores myndigheder og til teknologien, som anvendes dér.

Kunstig intelligens bruges allerede i det offentlige

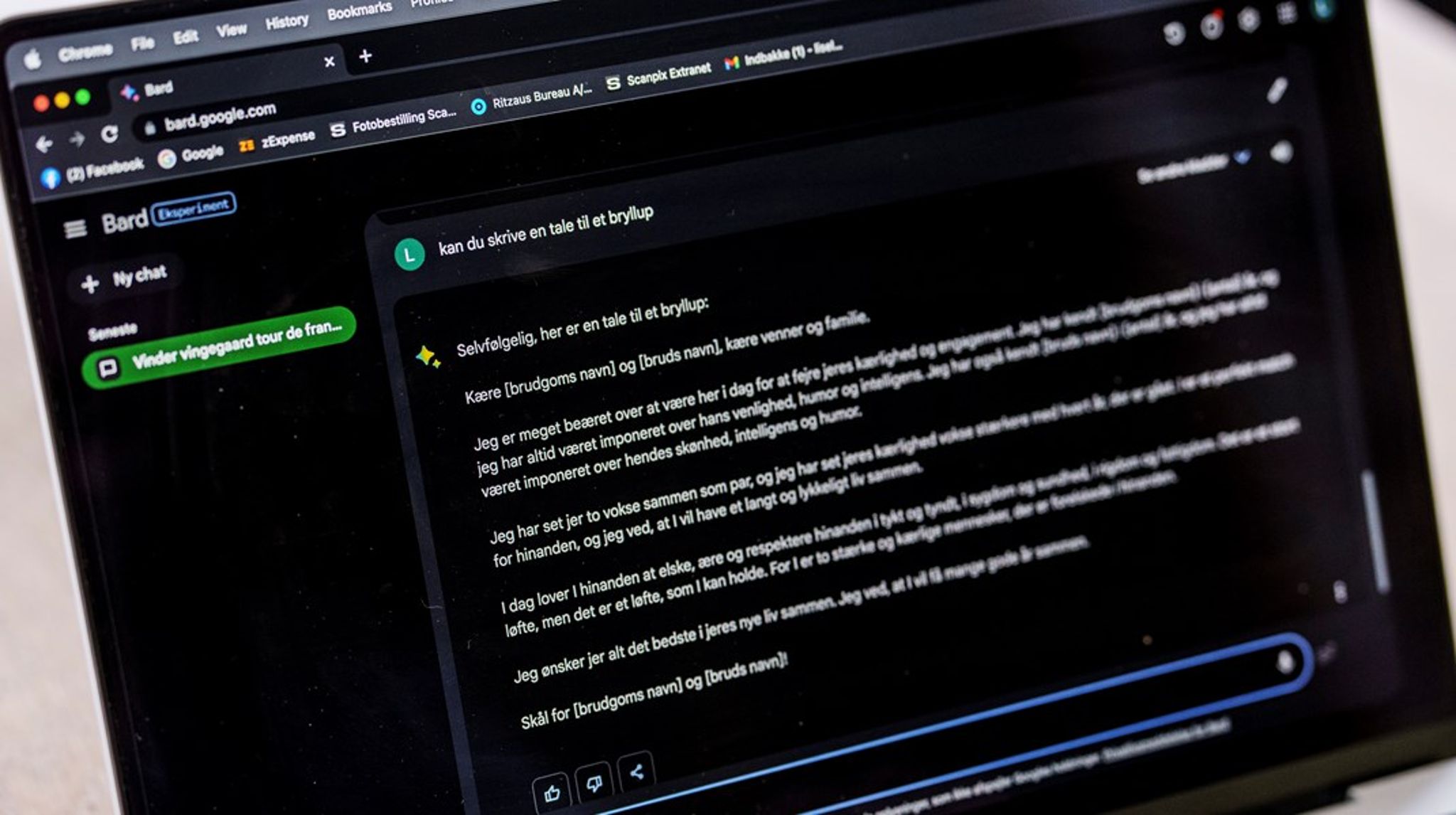

GenAI er kunstig intelligens, som kan skabe originalt indhold som tekst, billeder, lyd og video baseret på simple brugerinput. Teknologien har allerede vist sig nyttig i mange sammenhænge. Virksomheder bruger den til avancerede chatbots, som hjælper kunder, mens programmører bruger den til at lave udkast til softwarekode. Mange af os har også erfaringer med at bruge GenAI som privatpersoner til at lave tekster og billeder til alskens formål.

I den offentlige sektor bruges GenAI til at hjælpe medarbejdere med at løse deres opgaver, for eksempel ved at skrive udkast til eller læse korrektur på tekst.

Men GenAI bruges også i chatbots, der hjælper borgere, virksomheder eller medarbejdere med at søge information, og til at lave resuméer af samtaler, møder eller sager. De mange måder, GenAI kan anvendes, giver mange fordele, men det er vigtigt at huske på, at teknologien ikke er fejlfri.

Risikoen for fejl skyldes blandt andet, at GenAI kan "hallucinere" – det vil sige generere indhold, der virker troværdigt, men som er faktuelt forkert.

Johan Busse

Formand, Dataetisk Råd

Risikoen for fejl skyldes blandt andet, at GenAI kan "hallucinere" – det vil sige generere indhold, der virker troværdigt, men som er faktuelt forkert. Men GenAI kan også komme til at udelade vigtig information eller på andre måder generere indhold, som ikke løser opgaven korrekt.

Offentlige myndigheders arbejde berører ofte borgeres rettigheder, og vores samfund er afhængigt af, at vi hver især kan nære tillid til de offentlige myndigheder. Det gør risikoen for fejl til en central dataetisk udfordring, som vi er nødt til at løse.

Derfor har Dataetisk Råd udarbejdet otte anbefalinger til, hvordan offentlige myndigheder kan anvende GenAI på en dataetisk forsvarlig måde:

Vurder risikoprofilen i hvert enkelt brugsscenarie

Først og fremmest anbefaler Dataetisk Råd, at offentlige myndigheder systematisk vurderer GenAI-systemers risikoprofil. GenAI kan bruges på mange måder, og risici varierer afhængigt af, hvordan man anvender det. Derfor bør risikoen vurderes individuelt i hvert brugsscenarie.

En risikoprofil kræver, at myndigheden analyserer, hvor mange og hvilke typer fejl systemet laver, og hvilke konsekvenser disse fejl kan have. For eksempel er det vigtigt at skelne mellem anvendelser, hvor fejl kun har mindre konsekvenser, og anvendelser, hvor fejl kan påvirke borgeres rettigheder og velfærd og virksomheders rammebetingelser.

Tilpas kvalitetssikring til anvendelsen

Når man skal vide, hvor høj risikoen for fejl er, må man teste systemet. Denne kvalitetssikring er vanskeligere for GenAI end for andre former for kunstig intelligens, fordi tekniske metoder ofte har svært ved at måle GenAIs risiko præcist. Dataetisk Råd anbefaler, at offentlige myndigheder tilpasser testningen til det enkelte brugsscenarie.

Det betyder, at myndigheder bør udføre mere omfattende kvalitetssikring, jo større konsekvenser fejl har. I nogle tilfælde kan det være nødvendigt at lave ressourcekrævende manuelle tests, hvor mennesker vurderer kvaliteten.

Begynd med lavrisikoscenarier

Dataetisk Råd anbefaler også, at offentlige myndigheder, som ønsker at udforske eller anvende GenAI, begynder hvor risikoprofilen er lav. Et brugsscenarie kan have lav risikoprofil, når mennesker let kan opdage og rette eventuelle fejl, og når fejl har få konsekvenser.

Eksempler kunne være at bruge GenAI til at lave referater af interne møder, eller som idegenerator og korrekturlæser. Ved at starte med lavrisikoscenarier kan myndigheder opnå erfaring med teknologien, inden de eventuelt beslutter at udvide anvendelsen til mere kritiske funktioner.

Skab rammer for effektiv menneskelig kvalitetskontrol

I mange brugsscenarier er den vigtigste beskyttelse mod GenAI fejl, at mennesker opdager og retter fejlene, når de sker. Denne menneskelige kvalitetskontrol vil ofte være af afgørende betydning, når offentlige myndigheder anvender GenAI. Men effektiv menneskelig kvalitetskontrol er ikke en enkel opgave.

Rådet anbefaler, at regeringen etablerer et nationalt register over GenAI-systemer, der anvendes af offentlige myndigheder.

Johan Busse

Formand, Dataetisk Råd

Dataetisk Råd anbefaler, at offentlige myndigheder sikrer, at de medarbejdere, der skal udføre menneskelig kvalitetskontrol, kan løse denne opgave effektivt. Det kræver, at medarbejdere gives både kompetencer og ressourcer til at opdage fejl.

Lav forholdsregler, før fejlen opstår

Det er ikke muligt at gøre GenAI fejlfri. Derfor anbefaler Dataetisk Råd, at offentlige myndigheder udvikler forholdsregler for at håndtere fejl, inden de tager GenAI-systemer i anvendelse.

Myndigheder bør etablere procedurer for at identificere og dokumentere fejl samt for at oplyse berørte borgere og virksomheder, rette fejlen, og kompensere for eventuelle negative konsekvenser.

Tag stilling til, hvor høj risikoen må være

Hvis man stillede krav om, at GenAI-systemer skulle være ufejlbarlige, ville man i praksis forbyde anvendelse af GenAI. Omvendt ville ukritisk anvendelse af GenAI, uden hensyn til systemets risiko for fejl, være dataetisk uansvarligt.

Vi forventer med rette, at offentlige myndigheder gør sig store anstrengelser for at undgå fejl. Dataetisk Råd anbefaler, at offentlige myndigheder kun anvender GenAI, når risikoen for fejl er tilstrækkeligt lav. Konkret bør myndigheder stille stærkere krav til mitigering af risiko, jo større konsekvenser fejl vil have for borgere, virksomheder, samfund og miljø.

Gør brugen af generativ AI gennemsigtig

Gennemsigtighed er en hjørnesten i etisk brug af GenAI. Det første skridt er at gøre det klart, hvornår offentlige myndigheder anvender GenAI, og hvordan systemet er implementeret.

Rådet anbefaler, at regeringen etablerer et nationalt register over GenAI-systemer, der anvendes af offentlige myndigheder. Det vil sikre, at borgere og eksperter kan følge med i, hvordan teknologien anvendes, og hvilke foranstaltninger der er truffet for at minimere risici.

I mange tilfælde er det op til den enkelte myndighed at håndtere de vanskelige dataetiske udfordringer, som følger med.

Johan Busse

Formand, Dataetisk Råd

Indfør fælles offentlige retningslinjer

GenAI kommer til at spille en vigtig rolle i udviklingen af den offentlige sektor de kommende år. I mange tilfælde er det ikke desto mindre op til den enkelte myndighed at håndtere de vanskelige dataetiske udfordringer, som følger med. Samtidig gør mange af de dataetiske udfordringer, som den enkelte myndighed møder i arbejdet med GenAI, sig gældende på tværs af den offentlige sektor.

Derfor opfordrer Dataetisk Råd som sin sidste anbefaling til, at regeringen tager initiativ til at etablere fælles retningslinjer for hvordan offentlige myndigheder skal håndtere risikoen for fejl, når de anvender GenAI.

Danmark har en unik mulighed for at blive en global rollemodel for ansvarlig anvendelse af generativ AI. Dette kræver, at vi tager fat om de etiske udfordringer allerede nu. Vi skal være modige nok til både at udforske teknologien og sætte de nødvendige rammer for den.

Kun ved at tage etisk ansvar kan vi for alvor udnytte det enorme potentiale, som GenAI rummer, og samtidig beskytte de fundamentale rettigheder og principper, der udgør kernen i vores demokrati.

Artiklen var skrevet af

Indsigt

- Karina Lorentzen Dehnhardt spørgerHvilke initiativer vil ministeren tage, så Danmark også får ført sager mod techgiganterne?

Louise Brown spørger Sophie LøhdeHvorfor er reglerne ikke ændret, så onlineplatforme kan levere håndkøbsmedicin?

Louise Brown spørger Sophie LøhdeHvorfor er reglerne ikke ændret, så onlineplatforme kan levere håndkøbsmedicin?

Peter Skaarup spørger Rasmus StoklundHvilke redskaber anvender myndighederne til at forebygge radikalisering via sociale medier?

Peter Skaarup spørger Rasmus StoklundHvilke redskaber anvender myndighederne til at forebygge radikalisering via sociale medier?

- B 84 Anvendelse af kunstig intelligens i forbindelse med behandling af ansøgninger om dansk indfødsret (Udlændinge- og Integrationsministeriet)Fremsat

- L 111 Lov om supplerende bestemmelser til forordningen om kunstig intelligens (Digitaliseringsministeriet)1. behandling

- L 96 Lov om leje (Social- og Boligministeriet)1. behandling